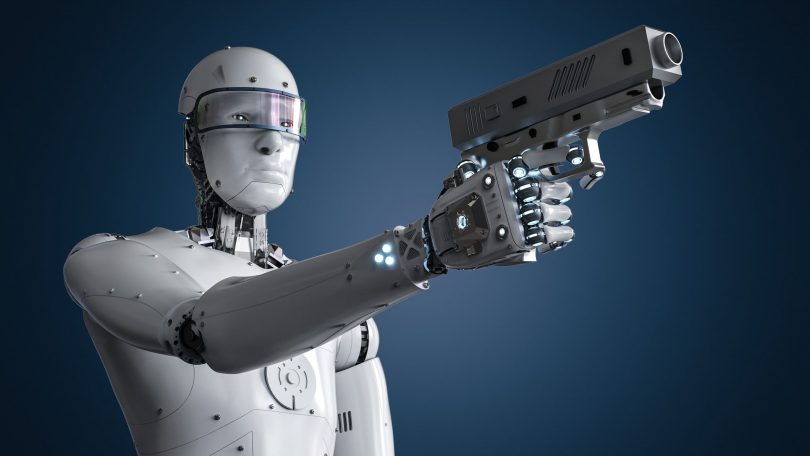

Google fjerner løfte om ikke at bruge AI til våben

Google har fjernet et tidligere løfte om ikke at udvikle kunstig intelligens til våben- eller overvågningsformål.

Det drejer sig om to specifikke formuleringer om at undgå AI, ”der forårsager eller sandsynligvis vil forårsage skade”, og at Google ikke må bruge kunstig intelligens til våbenformål eller kunstig intelligens, ”der indsamler eller bruger information til overvågning i strid med internationalt accepterede normer”.

Afsnittene er blevet erstattet af nye retningslinjer, som i stedet handler om ”ansvarlig udvikling og anvendelse”. De lægger vægt på ”passende menneskeligt tilsyn, due diligence og feedback-mekanismer, der er i overensstemmelse med brugernes mål, socialt ansvar og generelt accepterede principper for international lov og menneskerettigheder”.

James Manyika og Demis Hassabis, der leder Googles AI-laboratorium DeepMind, forsvarer ændringen og peger på den hurtige teknologiske udvikling, siden de tidligere AI-retningslinjer blev introduceret i 2018. De mener, at opdateringen afspejler AI-teknologiens voksende rolle i samfundet.

Perspektivering

Markedet for AI-løsninger er under hastig udvikling i disse år. I tvivl om forskellen på ChatGPT, Gemini, Copilot, Claude og alle de andre AI-chatbots? Se stor sammenligning af alle de bedste AI-chatbots.