Google satser alt på AI: Googles søgemaskine får AI-opgradering

Tirsdag aften gik Googles direktør Sundar Pichai på scenen ved virksomhedens store Google I/O-udviklerkonference.

Google er gået fra at være den førende AI-virksomhed for et par år siden til nu at holde sig konkurrencedygtig med den førende AI-virksomhed, OpenAI.

I løbet af den 90 minutter lange keynote var der et altoverskyggende tema: AI. Hvor Google I/O plejer at omhandle en bred vifte af Googles produkter – ja, sågar nogle gange lancering af ny hardware – var alt centreret omkring AI i år.

Vi giver dig her overblikket over de største AI-nyheder fra Google:

AI Overviews: AI-resultater i Googles søgemaskine

Google har allerede testet AI-resultater i toppen af Googles søgemaskine i USA. Da hed funktionen Search Generative Experience (SGE). Nu er funktionen rullet ud til alle brugere i USA, og flere lande – formentlig også Danmark – vil følge efter.

Google kalder den nye funktion “AI Overviews”, hvilket betyder, at der er AI-svar på det, du forsøgte at søge efter via Googles normale søgemaskine. Det giver dig også mulighed for at udvide dine søgninger en hel del.

Google viste blandt andet, at man kan anmode om forskellige yogalokaliteter i nærheden af den gade, man bor på, og søgemaskinen skabte en præsentabel liste over de forskellige lokaliteter, et kort, der viste, hvor de var, og en oversigt over deres priser.

Google demonstrerede også, at man kan bede om en 3-dages madplan, og så får man en række forslag til retter, som man kan lave. Du kan manuelt justere måltiderne og bede om nye forslag, og når du er tilfreds, kan du omdanne alle opskrifterne til en indkøbsliste, ligesom du også kan købe alle ingredienserne.

Googles AI-resultater linker også til de hjemmesider, som Google henter oplysningerne fra, men der er næppe tvivl om, at mange hjemmesider vil miste en masse organisk trafik, som de tidligere har fået fra Google, nu hvor Google vil besvare flere spørgsmål direkte på Google.com i stedet for at sende brugerne videre til de enkelte hjemmesider.

Se også: Google integrerer Gmail, Maps og YouTube i AI-chatbotten Gemini

Gemini Live – en mere personlig AI-samtale

I går annoncerede OpenAI en kraftigt forbedret stemmestyret udgave af ChatGPT, og en lignende funktionalitet annoncerede Google med funktionen “Gemini Live”, som bliver tilgængelig til sommer.

Med Gemini Live kan man føre en samtale med AI-assistenten, og den vil tilpasse sin kommunikationsstil ud fra din egen stemme og tone.

Det bliver kun til en start ”kun” muligt at gennemføre lydsamtaler, men Google arbejder også på at gøre det muligt at kommunikere med Gemini Live via video senere på året.

Google afslørede også noget, der hedder “Gems”, som i praksis betyder, at man kan gemme forskellige personlighedstyper til AI’en. For eksempel om du vil have den til at opføre sig som en sjov bedste ven eller en vidende lærer.

Der var også en demonstration af noget, som Google kalder “Project Astra”, som skulle være Googles fremtidsvision for, hvordan de forestiller sig, at Google Assistant faktisk skal være. Dette blev heller ikke demonstreret med en live-demo, som OpenAI gjorde med GPT-4o, og alt vi så var blot en forudindspillet video. Videoen viste en person, der gik rundt med sin mobiltelefon, pegede på forskellige ting og stillede spørgsmål om det, de så. Man så også, at Gemini kan huske ting, den havde set før i løbet af videoen – for eksempel hvor brugeren havde lagt sine briller.

Demoen var ganske imponerende, men med OpenAI’s præsentation fra mandag aften, hvor de viste endnu mere imponerende demoer direkte på scenen, var det heller ikke helt revolutionerende.

Se også: OpenAI lancerer GPT-4o – hurtigere sprogmodel med forbedret stemmetilstand

Google Fotos får opgraderet AI-søgemaskine

Søgningen i Google Fotos får nu en meget praktisk AI-opgradering. Med den nye funktion Ask Photos kan du spørge om specifikke ting som “hvad er registreringsnummeret på min bil?”. Ud fra konteksten vil den kunne forstå, hvilken bil du har taget et billede af, der er din, og derefter vise dig det ene billede, der viser dit nummer.

Tidligere skulle man søge efter “nummerplader” og derefter potentielt scrolle gennem en masse billeder af nummerplader eller biler.

Den kan også skabe en samling af billeder. I et eksempel viste Google, at man kan spørge “hvornår lærte Lucia at svømme?”, men også “vis mig, hvordan Lucia har lært at svømme gennem årene” for at få en række billeder, der viser Lucia (dvs. datteren i eksemplet) i forskellige svømmescenarier gennem årene.

Se også: Hvilken AI-chatbot skal jeg vælge? Se de 11 bedste chatbots

Gemini 1.5 Pro med 2 mio. tokens

Gemini 1.5 Pro og dens understøttelse af såkaldt “lang kontekst” og 1 million “tokens” var også en stort samtaleemne på scenen. Tokens er grundlæggende informationsblokke, og jo flere tokens, jo mere indhold kan du bede AI’en om at behandle.

Google udvider nu mængden af tokens i Gemini 1.5 Pro fra en million tokens til to millioner tokens. Alle (dog kun betalende) udviklere i hele verden kan få adgang til Gemini 1.5 Pro med en million tokens i dag, mens der kun er en lille “privat forhåndsvisning” for to millioner tokens.

For at sætte det i perspektiv skulle en million tokens svare til cirka 30.000 kodelinjer, en 1.500 sider lang PDF-fil eller en times video. Det skulle ifølge Google være det største “kontekstvindue” i nogen generativ AI-tjeneste.

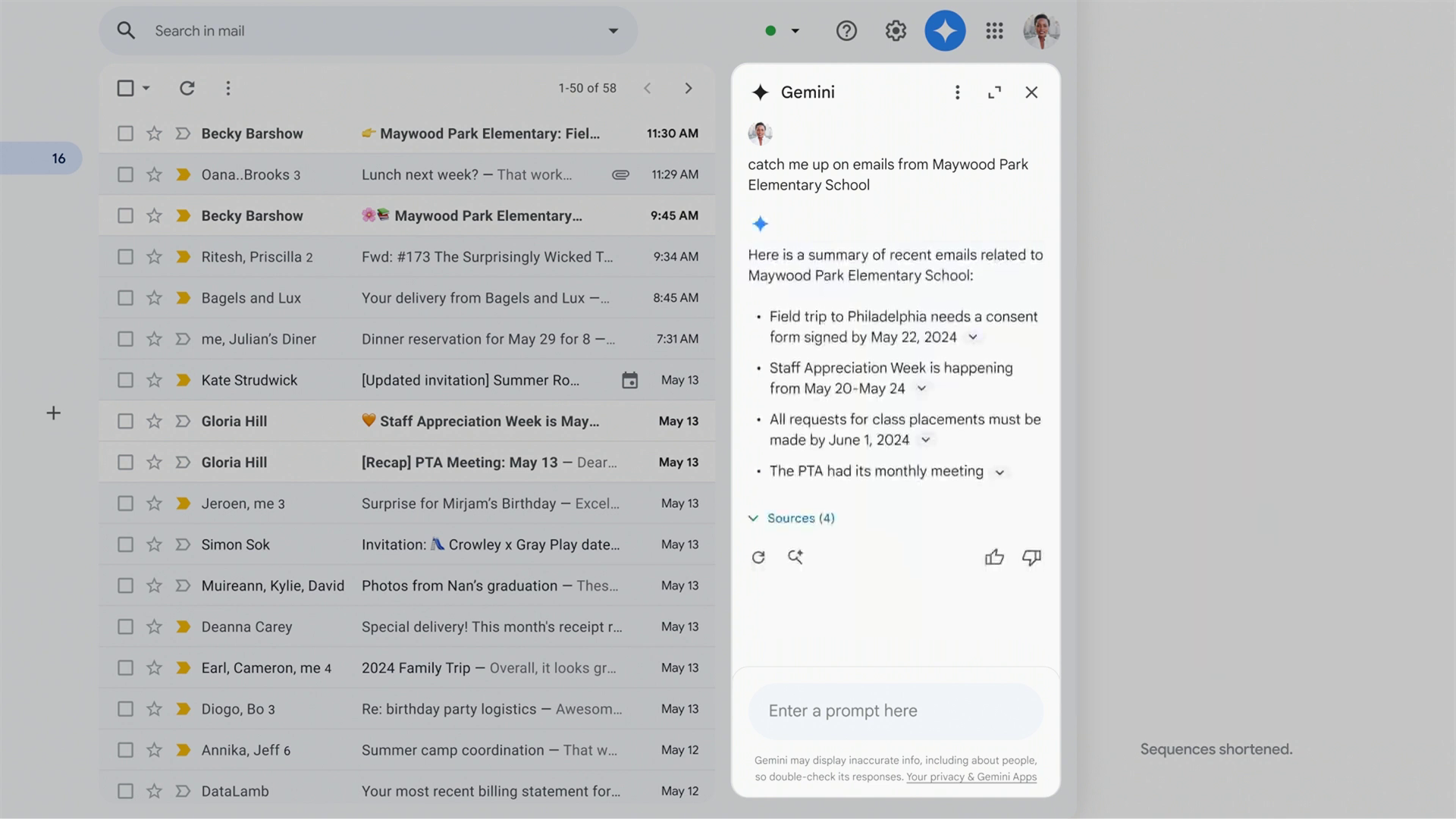

AI Sidebar i Gmail, Drev, Docs og Sheets

Google Gemini kommer også til din e-mailindbakke. Du kan for eksempel bede AI’en om at opsummere alle de e-mails, du har modtaget fra dine børns skole på det seneste, og få en overskuelig liste over de forskellige ting, du har brug for at vide.

Hvis nogen har holdt et møde gennem Google Meet og optaget det, kan du anmode om et resumé af hele mødet.

Det, der kaldes “AI Sidebar”, vil også blive lanceret i denne måned og vil være en altid tilgængelig AI-assistent, der er til stede i din Gmail-indbakke samt i Docs, Drev, Præsentationer og Sheets.

AI Sidebar kan blandt andet hjælpe dig med at organisere indholdet i din indbakke. Hvis du for eksempel har en masse regninger fra forskellige steder, kan den automatisk oprette et overskueligt Google Sheets-dokument med disse data. Den kan også automatisere det, så fremtidige regninger i din indbakke også bliver føjet til det samme dokument.

Se også: Hvorfor er ChatGPT så langsom? Gode tips og tricks til hurtigere svar

Googles AI kan hjælpe med skoleopgaver

En ret cool funktion i Google Notebook blev også demonstreret.

En masse forskellige skoleprojekter, lange tekster, rapporter og grafer blev uploadet, og du kunne bruge AI til at lave en studievejledning til alt indholdet eller en FAQ eller quiz for at kontrollere, at du har lært indholdet.

En ny funktion er, at den også kan skabe en slags interaktiv samtale for at forklare indholdet. To stemmer ville begynde at diskutere emnerne, og når som helst kan du selv springe ind og stille spørgsmål, og samtalen vil ændre sig for at besvare det spørgsmål, du stiller.

Det virkede lidt langsommere end OpenAI GPT-4o, men stadig ret hurtig.

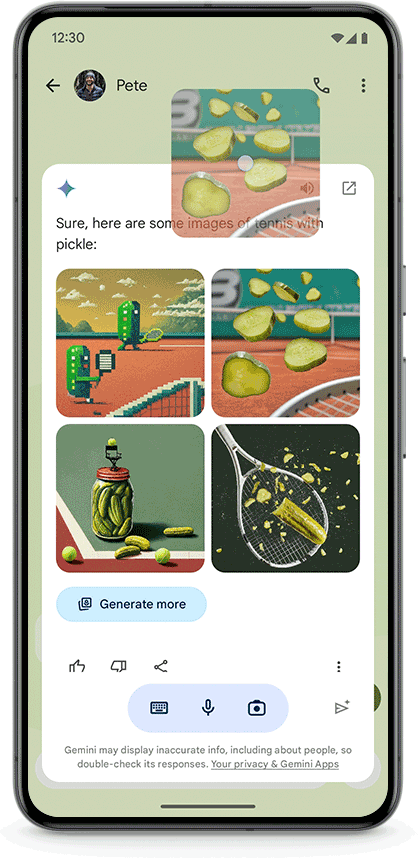

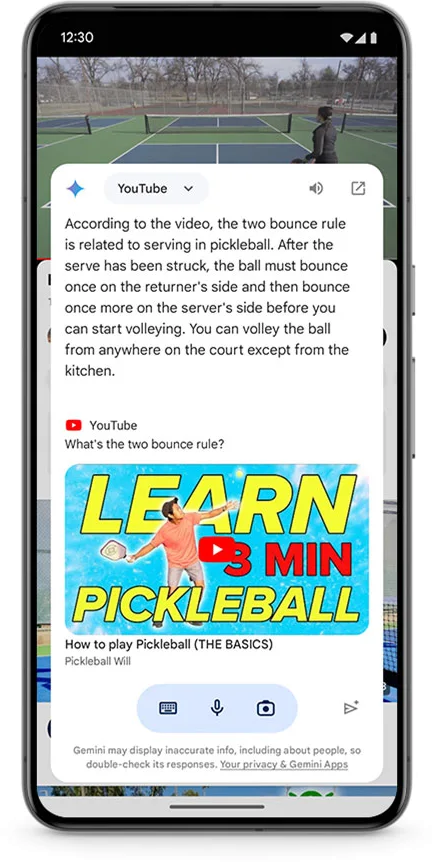

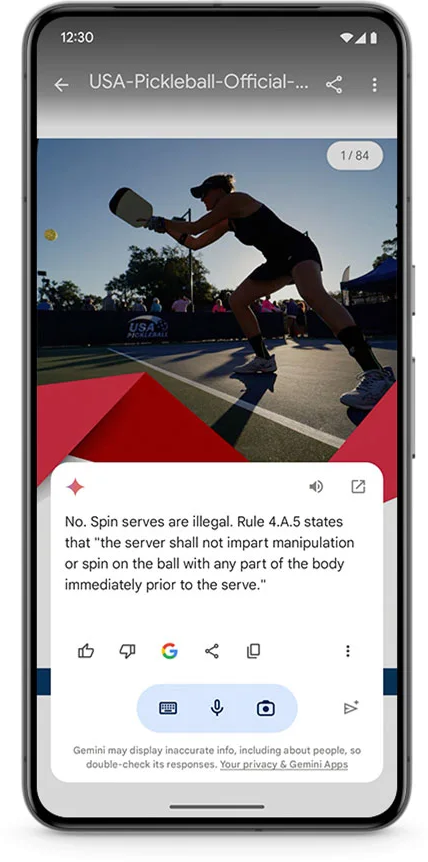

Nye AI-funktioner i Android

Android får selvfølgelig også en AI-overhaling, og det blev demonstreret, hvordan man kan få AI-assistenten Gemini frem på skærmen som et slags lag over andre apps. Hvis du for eksempel er i Besked-appen, kan du få Gemini til at svæve over og hjælpe dig med indholdet i dine beskeder. Du kan for eksempel bede AI’en om input til, hvad du skal skrive, eller lave sjove billeder, som du kan trække ind i chatvinduet nedenunder.

Circle to Search, som først dukkede op på Samsung-mobiler tidligere i år, bliver nu gjort bredt tilgængelig. Ud over at man kan tegne cirkler om ting på billeder for at få shoppingtips, kan man nu også sætte cirkler om en matematikopgave og få hjælp til at løse den.

Der vil nu også være AI-funktioner, som kun behandles lokalt på mobilen. Dette kommer til Googles Pixel-telefoner senere i år og kaldes “Gemini Nano med multimodalitet”.

Det kan for eksempel bruges til at forbedre “TalkBack”-tjenesten, som bruges af synshandicappede. Ofte støder de på billeder, som ikke har nogen beskrivelse, men nu kan AI hjælpe brugerne med at forklare, hvad billedet indeholder.

AI kan også bruges til at opdage svindel. Forestil dig, at en “bankmedarbejder” ringer til dig og siger, at de har opdaget usædvanlig aktivitet på din konto. For at hjælpe dig har de oprettet en ny, sikker konto, som du kan flytte dine penge til. Pludselig dukker der en meddelelse op på din skærm, som siger, at det nok er svindel, og at en rigtig bank aldrig ville have bedt dig om at flytte penge for at beskytte dig.

Det blev gentaget, at alt udelukkende sker på mobilen, og at ingen af de personlige oplysninger eller lydfiler sendes til Google.

Stor omvæltning

Googles introduktion af generativ AI i sin søgemaskine er et skridt, der har været længe undervejs, men søgegiganten har været tøvende, fordi det er en teknologi, der laver fuldstændig om på, hvordan Googles kerneforretning fungerer.

Google tjener de fleste af sine penge på annoncer fra søgeresultater, og med generativ AI i søgemaskinen kommer “Google til at google for dig”, som selskabet selv forklarer det. Alt man selv skal gøre er at spørge, og straks får man et personligt svar på meget komplekse forespørgsler.

Det betyder selvsagt, at brugerne kommer til at besøge langt færre hjemmesider gennem den klassiske resultatvisning, idet de ofte vil få deres svar gennem de AI-generede resultater. Hjemmesider, der lever af at servere indhold til Google, skal formentlig derfor indstille sig på at gennemgå en større omvæltning i de kommende år.

Google vil stadig linke til hjemmesider via AI-genererede svar, men indholdsskabere får formentlig mindre kontrol med, hvor og hvordan indholdet indgår i AI-genererede resultater.