Apple har scannet e-mails for materiale med børnemisbrug siden 2019

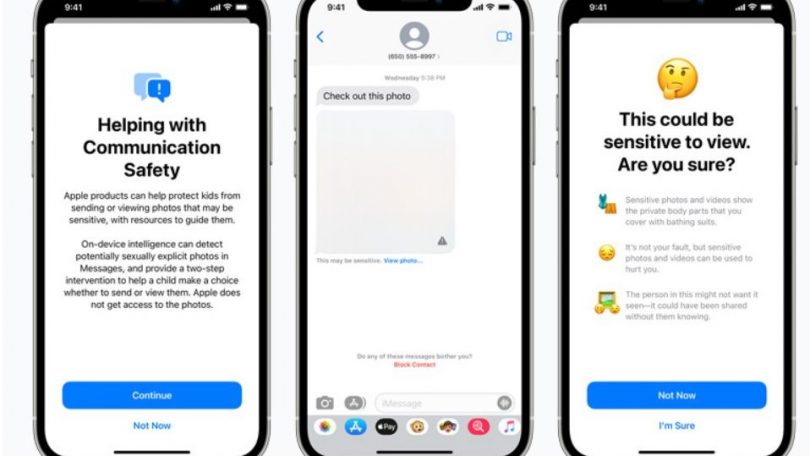

Mange Apple-fans er oprørte over virksomhedens plan om at begynde at scanne efter materiale med børnemisbrug (CSAM) i iCloud Fotos uploads senere på året. Faktum er, at de allerede har scannet efter CSAM i dine e-mails siden 2019. Det bekræfter Apple selv i et interview.

Apple bekræfter: Har scannet mails for børnemisbrug siden 2019

“Apple har bekræftet over for mig, at de har scannet udgående og indgående iCloud Mail for CSAM-bilag siden 2019,” skriver Ben Lovejoy for 9to5Mac.

Apple oplyste samtidig, at de også foretog en begrænset scanning for andre data, men de ville ikke fortælle Ben Lovejoy, hvilken data det var.

Lovejoy gør opmærksom på, at Apple faktisk ikke har holdt det ikke hemmeligt. På en arkiveret version af deres websted om børnesikkerhed står der, at Apple bruger billedmatchningsteknologi til at hjælpe med at finde og rapportere misbrug af børn. Ligesom spamfiltre i e-mail bruger Apples system elektroniske signaturer til at finde formodet udnyttelse og seksuelt misbrug af børn.

Se også: iPhones du trygt kan købe

Andre scanner også efter misbrug af børn

Udvidelsen kan have noget at gøre med, at en række af Apples rivaler, herunder Microsoft, også scanner efter CSAM-indhold.

Apple kan have følt, at det ikke ser godt ud, hvis andre platforme arbejder på at udrydde CSAM, mens Apple vender det blinde øje til. Det har ført til heftig debat af Apples privacypraksis med denne scanning. Mange frygter at det åbner op for Pandoras æske med masseovervågning til følge. Særligt ikke-demokraktiske regimer frygtes at ville benytte metoden til at lede efter personer, de ikke bryder sig om.

Se også: Nyheder om sikkerhed og privacy