Ny AI-videogenerator vækker Mona Lisa til live

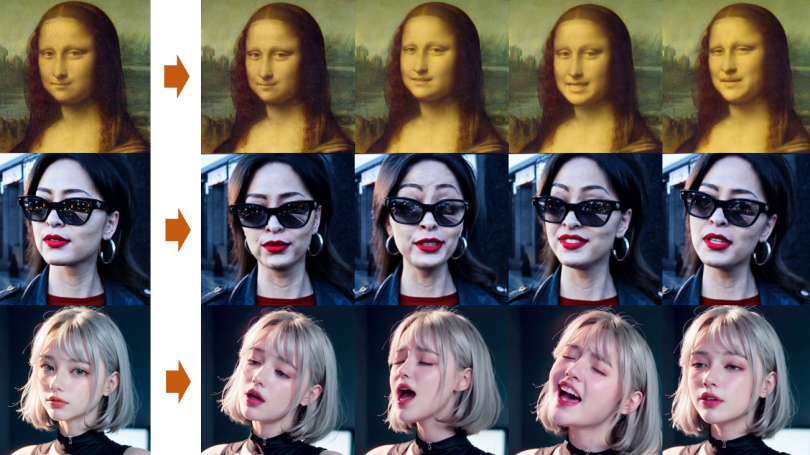

Den kinesiske techgigant Alibaba har præsenteret sit bud på en AI-videogenerator. EMO (Emote Portrait Alive), som den hedder, er i stand til at omdanne portrætfotos til levende videoer af personer, der synger og snakker – blandt andet Mona Lisa.

Læs også: OpenAI’s nye AI-model Sora genererer hyperrealistiske videoer

Damen fra OpenAI’s Sora kan pludselig synge

Alibaba vil uden tvivl have dig til at sammenligne deres nye AI-videogenerator med den meget hypede Sora-videogenerator fra OpenAI, som blev præsenteret for knap to uger siden.

Det må være forklaringen på, at det kinesiske selskab har demonstreret AI-videogeneratoren med et stillbillede fra en af de AI-generede videoer, som OpenAI brugte til at vise Sora frem.

EMO er endnu ikke tilgængelig til brug, men er blevet beskrevet i en videnskab artikel på Github. I en række videoer offentliggjort på GitHub demonstrerer Alibaba AI’en, som er i stand til at vække de døde til live på ret imponerende vis.

Karakter: AI Mona Lisa genereret af dreamshaper XL Vokal: Miley Cyrus – Flowers. Cover af YUQI |

Karakter: AI-dame fra Sora Vokal: Dua Lipa – Don’t Start Now |

Karakter: AI-pige genereret af ChilloutMix Vokal: David Tao – Melody. Cover af NINGNING (mandarin) |

Karakter: AI Ymir fra AnyLora & Ymir Fritz Adult Vokal: 『衝撃』Music Video【TVアニメ「進撃の巨人」The Final Season エンディングテーマ曲】 (japansk) |

Karakter: Leslie Cheung Kwok Wing Vokal: Eason Chan – Unconditional. Cover af AI (kantonesisk) |

Karakter: AI-pige genereret af WildCardX-XL-Fusion Vokal: JENNIE – SOLO. Cover af Aiana (koreansk) |

Karakter: Leonardo Wilhelm DiCaprio Vokal:: Eminem – Godzilla (Ft. Juice WRLD) cover |

Karakter: KUN KUN Vokal: Eminem – Rap God |

Karakter: Audrey Kathleen Hepburn-Ruston Vokal: Interviewklip |

Karakter: AI Chloe: Detroit Become Human Vokal: Interviewklip |

Karakter: Mona Lisa Vokal: Shakespeares monolog II As You Like It |

Karakter: AI Ymir fra AnyLora & Ymir Fritz Adult Vokal: NieR: Automata |

En af videoerne er OpenAI’s AI-genererede dame, der er blevet nærmest berømt for at gå rundt i en AI-genereret udgave af Tokyo. Efter at have været gennem Alibabas AI-generator synger Sora-damen nu “Don’t Start Now” af Dua Lipa.

En anden demo viser Audrey Hepburn tale til lyden fra et viralt klip af Lili Reinhart fra Riverdale, der taler om, hvor meget hun elsker at græde.

Læs også: Apple kommer med banebrydende AI-nyheder i år

Stadig langt fra færdigudviklet

Fælles for mange af demoerne er, at de ikke udtrykker tale, men derimod sang. Der er ikke eksempler på personer, der taler ved brug af kraftige ansigtsudtryk, og det er uvist, hvor velfungerende EMO er på det punkt.

På trods af det skulle den være en polyglot, der er i stand til at opfange de sproglige lyde (fonemer) på flere sprog og få ansigterne til at danne de relevante fonemer med fornuftig – men langt fra perfekt – nøjagtighed.

EMO lader også til at være i stand til at generere mange små ting som sammenknebne læber eller et blik nedad mellem sætninger, som indsætter følelser i pauserne i stedet for bare de tidspunkter, hvor læberne bevæger sig.

Ligesom med Sora fra OpenAI er der endnu ikke en offentlig udgave tilgængelig, så Alibaba har – må vi forvente – udvalgt de bedste AI-generede videoer.

Kæmpe forbedringer på få år

Ikke desto mindre er EMO en gevaldig forbedring i forhold til Audio2Face, som Nvidia lancerede for bare to år siden. Nvidias løsning var afhængig af 3D-animerede data til at skabe sine output, mens EMO altså blot skal bruge et stillbillede.

Udviklingen af AI går altså lynende hurtigt, så hvem ved, hvad vi får at se i løbet af de næste måneder af imponerende AI-løsninger?

Læs også: OpenAI giver humanoide robotter en kognitiv AI-opgradering