Apples Personal Voice kan genskabe en stemme på 15 minutter

Som en del af de opdateringer i iOS 17, der har fokus på tilgængelighed, har Apple præsenteret et par nye funktioner med navnene Live Speech og Personal Voice.

Med Live Speech kan brugerne skrive det, de vil sige, og derefter få det læst højt. Det vil nogen nok sige, er brug af en art kunstig intelligens, men den anden funktion, Personal Voice har dog mere snert af kunstig intelligens. Kunstig intelligens var ellers noget, som Apple nærmest ikke nævnte med et ord under deres keynote til WWDC 2023, som foregik i sidste uge.

Se også: Priser på iPhone

Kan hjælper personer der mister stemmen

Personal Voice er en funktion, der skal hjælpe dem, der er i risikozonen for at miste evnen til at tale, så de kan skabe og gemme en stemme, der lyder som dem selv. Apple fortæller at den er designet til dem, der risikerer at miste sin stemme for eksempel til følge af en sygdom som ALS.

Nu, hvor den første beta af iOS 17 er ude, kan man også prøve Personal Voice selv.

Apple beskriver den nye Live Speech-funktion på denne måde:

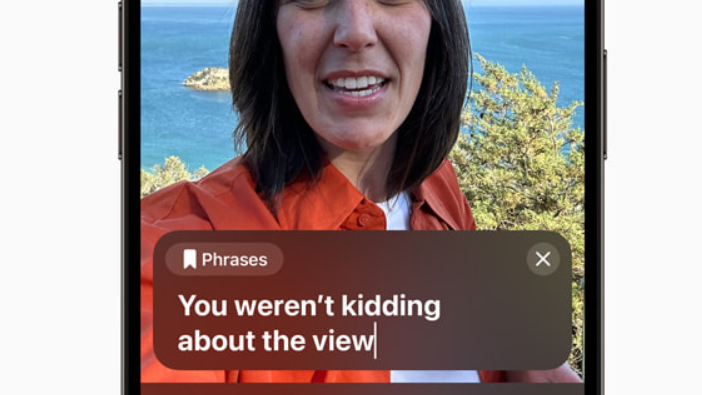

“Med Live Speech på iPhone, iPad og Mac kan brugerne skrive, hvad de vil sige, og få det sagt højt under telefon- og FaceTime-opkald samt personlige samtaler. Brugerne kan også gemme ofte brugte sætninger, så de hurtigt kan komme ind i en livlig samtale med familie, venner og kolleger. Live Speech er designet til at støtte millioner af mennesker verden over, som ikke kan tale, eller som har mistet deres tale med tiden.”

Se også: Hvilken iPhone er bedst?

Kunstig version af ens personlige stemme

Som en videreudvikling af Live Speech har Apple udviklet Personal Voice, denne meget effektfulde funktion tiltænkt personer, der er i fare for at miste sin evne til at tale.

Det kan for eksempel være personer med en ALS-diagnose, en sygdom der med tiden påvirker personens taleevne. Ved hjælp af Personal Voice bliver man bedt om at læse en række tekster højt, så funktionen kan optage ens stemme i 15 minutter med en iPhone eller iPad.

Funktionen benytter derefter machine learning lokalt i enheden til at genskabe en stemme, der lyder som den oprindelige. Den stemme kan derefter bruges i Live Speech, så man kan tale med sin rigtige stemme i en FacecTime-samtale eller i en almindelig samtale med en anden person.

I Apples præsentation af funktionen står følgende:

” For brugere, der er i fare for at miste evnen til at tale – såsom dem med en nylig diagnose af ALS (amyotrofisk lateral sklerose) eller andre tilstande, der gradvist kan påvirke taleevnen – er Personal Voice en enkel og sikker måde at skabe en stemme, der lyder som dem. Brugere kan oprette en personlig stemme ved at læse med på et randomiseret sæt tekstprompter for at optage 15 minutters lyd på iPhone eller iPad. Denne taletilgængelighedsfunktion bruger maskinlæring på enheden til at holde brugernes oplysninger private og sikre, og den integreres problemfrit med Live Speech, så brugerne kan tale med deres personlige stemme, når de er i kontakt med deres kære.”

Det, den funktion i bund og grund gør, er at give folk mulighed for at skabe en kunstig version af deres egen stemme på en iPhone ved at læse tekststykker udvalgt af Apple.

Se også: Får min iPhone iOS 17?

Vigtigt at kunne kommunikere med stemmen

Philip Green, der fik diagnosen ALS i 2018 og er bestyrelsesmedlem og talsperson for Team Gleason nonprofit, hyldede i en udtalelse tirsdag Apples indsats på området:

“I sidste ende er det vigtigste at kunne kommunikere med vennerne og familien,” siger Philip Green, bestyrelsesmedlem og ALS-talsmand for nonprofitorganisationen Team Gleason. Han har selv oplevet betydelige forandringer i sin stemme, siden han blev diagnosticeret med ALS i 2018. “Det gør en verden til forskel at kunne fortælle dem, at du elsker dem, med en stemme, der lyder som din egen. Og det er helt fantastisk, at man kan skabe en syntetisk stemme på iPhone på blot 15 minutter.”

Apple fortæller, at de nye funktioner med tilgængelighedsfokus rulles ud senere på året. Udover Live Speech og Personal Voice er der endnu nogle funktioner med fokus på tilgængelighed med i pakken.

Apple har altid været førende, når det kommer til funktioner med tilgængelighedsfokus, og dette er blot det seneste eksempel på det. Denne gang har de taget det et skridt videre og virkelig udviklet funktioner, der kan få stor betydning for de ramte familier.